cet article (12/12) s’inscrit dans une série de douze articles sur la naturopathie rédigée avec la volonté de porter un regard détaillé et critique sur la discipline, et dont vous pourrez trouver le sommaire ici. Il ne s’agit pas de partir en quête d’une vérité absolue, mais d’alimenter des réflexions destinées à éviter de causer ou laisser perdurer des souffrances inutiles, de permettre à chacun.e de faire les meilleurs choix en termes de santé. Dans ce douzième et dernier article, il s’agira de proposer une conclusion.

Pour résumer succinctement le contenu très dense des précédents articles, nous avons évoqué les prétentions préventives et curatives de la naturopathie en terme de santé, prétentions basées sur l’usage de méthodes dites traditionnelles et de traitements dits naturels.

Dans le contexte légitime de défiance généralisée vis à vis de la médecine, la naturopathie tire son épingle du jeu et assure avoir un rôle complémentaire à celui des professionnel.les du parcours de soin conventionnel. Elle porte dans le même temps un regard excessivement critique sur la médecine et ses traitements, minimisant leurs bienfaits et exagérant leurs effets secondaires. Cependant, bien qu’iels soient très critiques des conflits d’intérêts observés dans le milieu médical, les naturopathes ne dénoncent pourtant pas avec la même énergie les innombrables conflits d’intérêt qui les lient aux laboratoires de compléments « naturels », ni même le business juteux de la formation.

Pour ce qui concerne ses effets, contrairement au causalisme affiché, la naturopathie échoue à identifier les causes réelles de maladies, pas plus qu’elle ne réussit à en faire taire les symptômes. De plus, peu d’outils employés en naturopathie ont apporté la preuve de leur efficacité (tout au plus quelques recommandations alimentaires et d’hygiène de vie basiques). Et ces rares outils éprouvés, en plus de ne pas être propres à la naturopathie, sont depuis bien longtemps déjà intégrés à la pratique quotidienne des professionnel.les de santé.

Mais si la naturopathie n’a pas apporté la preuve de son efficacité à prévenir ou guérir les maladies, elle n’est pas pour autant une discipline sans danger. Le principal risque associé à la naturopathie, c’est en effet la perte de chance d’être soigné.e, le risque de s’éloigner de la médecine et de ses traitements. On peut également citer le risque de développer des carences ou des troubles du comportement alimentaire, mais aussi les risques trop souvent sous-estimés associés à la consommation de compléments alimentaires et autres cures détox (allergie, intoxication, interaction médicamenteuse…).

Soulignons également l’essentialisme qui sous-tend les pratiques et discours de la naturopathie au féminin, qui malgré une aura de bienveillance, demeure particulièrement sexiste et défavorable aux intérêts des femmes et minorités de genre.

Tout du long de cette série d’articles, j’ai parlé de « médecines alternatives et complémentaires », pour reprendre l’expression couramment employée dans la littérature scientifique. Pourtant, la naturopathie n’est en rien complémentaire de la médecine, et encore moins une alternative valable à celle-ci. Certaines personnes parlent plutôt de « médecine douce », mais comme nous l’avons évoqué précédemment, les effets de la naturopathie n’ont parfois rien de doux ou d’innocent. D’autres personnes encore parlent de « médecine parallèle », de « médecine naturelle » ou de ou « pratique de soin non conventionnelle ». Or, je ne pense pas qu’il soit raisonnable de parler de « médecine » ou de « soin » alors que la discipline échoue à prouver son efficacité en terme de santé. Pour toutes ces raisons, je choisis le plus souvent de parler de « pseudo-médecine » ou de « fake-med ».

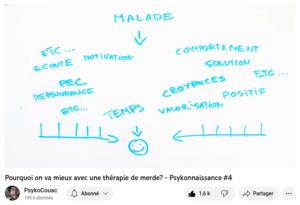

Car le terme « pseudo-médecine » fait référence à une pratique à visée thérapeutique qui n’a pas apportée la preuve de son efficacité au-delà de l’effet placebo, en opposition avec la médecine (parfois nommée « médecine conventionnelle » ou « médecine basée sur les faits » / « evidence-based medecine »), qui repose quant à elle sur des éléments factuels et scientifiques et dont les outils ont prouvé leur efficacité.1

Pour terminer cette série d’articles, il me semblait important d’évoquer une notion qui m’est chère, celle du consentement. Le code de déontologie médicale prévoit que le consentement des patient.es aux soins proposés doit être libre et éclairé.2 Bien que cette garantie soit imparfaite3, c’est une composante majeure du respect de l’autonomie et de la volonté des patient.es. Ce consentement doit être donné après avoir reçu préalablement du médecin une information claire, complète, compréhensible et appropriée à sa situation, notamment sur les risques et bénéfices des traitements proposés et leurs alternatives.

Les naturopathes et autres pseudo-thérapeutes ne sont pas soumis à la même obligation, ce qui pose un évident problème d’ordre éthique. Car leurs client.es ne reçoivent pour ainsi dire jamais d’information préalable sur l’absence de preuve scientifique relative à l’efficacité des méthodes proposées, sur les alternatives médicales éprouvées, ni même sur les risques d’effets secondaires les plus courants. Ainsi, les client.es des pseudo-médecines ne sont pas en mesure de fournir un consentement éclairé aux traitements « naturels » qui leur sont proposés.

Et cela m’interroge… Imaginez : si on prenait le temps d’expliquer aux personnes qui souhaitent consulter un.e naturopathe que la discipline n’a pas démontré avoir la moindre efficacité propre, mais qu’elle présente par contre plusieurs risques avérés et des conflits d’intérêts importants avec les laboratoires, ces personnes seraient-elles aussi nombreuses à franchir la porte d’un cabinet naturopathique ?…

Peut-être, peut-être pas… Mais il me semble essentiel que chacun.e puisse faire ses choix en connaissance de cause, de manière libre et éclairée.

Cependant, ne dépolitisons pas le sujet !

Nos actions principales pour minimiser les souffrances liées aux pseudo-médecines ne devraient pas se résumer à des considérations individuelles en promouvant l’enseignement de l’esprit critique. Surtout si cela s’intègre dans la tendance observée chez certaines personnes se revendiquant du scepticisme à… prendre les gens pour ces cons ! Notamment en soutenant l’idée que certaines personnes penseraient mieux que d’autres parce qu’elles ont appris la liste des sophismes, biais cognitifs et arguments fallacieux. Ce qui est à la fois erroné et politiquement discutable.4

Pour combattre les dangers de pseudo-médecines, nous devrions déjà partir du constat qu’aussi longtemps que l’on ne se donnera pas les moyens de résoudre la crise de confiance qui touche le monde médical et scientifique, les arguments scientifiques n’auront que peu de poids dans cette lutte… Il parait donc pertinent de, certes promouvoir l’esprit critique, mais surtout de militer activement :

- Pour réformer la formation des professionnel.les de santé : les sensibiliser à la qualité de la relation thérapeutique, aux mécanismes d’oppressions, à ce qui rend les pseudo-médecines si attractives, à l’importance de susciter l’adhésion des patient.es au projet thérapeutique etc…

- Pour assurer l’indépendance des professionnel.les de santé et de nos décideurs politiques vis à vis des laboratoires et des lobbys de l’industrie agro-alimentaire (cf. les travaux du collectif Formindep),

- Pour combattre les déserts médicaux et les inégalités d’accès aux soins,

- Pour prendre des mesures permettant des consultations médicales plus longues,

- Pour faire prendre en charge par la sécurité sociale les accompagnements par les professionnel.les de la diététique et des psychothérapies éprouvées,

- Pour faire appliquer les lois qui protègent les patient.es en sanctionnant l’exercice illégal des professions de santé réglementées (médecine, diététique, pharmacie…),

- entre autres choses…