Ce cours s’adresse aux étudiants de L2 et L3 de toutes les spécialités de l’université Lyon I. Il s’intègre dans les enseignements intitulés « Transversales : Sciences Humaines et Sociales ». Les contraintes administratives nous obligent à organiser ce cours sous la forme d’un stage intensif de 15h réparties sur une semaine.

Depuis 2010, Denis Machon, Maître de conférences au département de Physique, anime ce cours en présence d’une cinquantaine d’étudiants en moyenne. Depuis cette année Maïlys Faraut, doctorante en neurobiologie, intervient également, et nous donne son analyse plus bas.

[toc]

Analyse de Denis

Genèse

Objectifs

Les objectifs de ce cours sont :

1 – De sensibiliser les étudiants à l’autodéfense intellectuelle : problématique des pseudo-sciences, importance de la démarche d’investigation, méthodes de manipulation, medias, etc.

2 – D’informer les étudiants de la possibilité d’accéder à une information contradictoire (bibliographie et sites web) en présentant les acteurs de la zététique.

3 – De traiter des cas précis afin de fournir un argumentaire et de clarifier des situations floues.

4 – L’objectif primordial est la présentation d’une méthode, de pièges à éviter et d’outils pour pouvoir se faire une opinion « éclairée ».

Déroulement

Le stage se répartit en 5 séances de 3h.

Séance 1 : une introduction qui pose une problématique. Il s’agit de montrer le fait que d’avoir accès aux études supérieures n’est en rien la garantie d’être à l’abri de confusion entre sciences et pseudo-sciences (même pour des étudiants scientifiques qui constituent le public de ce cours), que cette confusion est très répandue et ouvre la possibilité à de nombreuses dérives, que les pseudo-sciences occupent une part non-négligeable de notre vie.

Points forts : les étudiants sont sensibles à ces informations qui les concernent et leur font sentir qu’ils ne sont pas à l’abri de dérapages pseudo-scientifiques.

Points faibles : les études et les données présentées datent un peu. Des sources plus récentes à nous communiquer ?

Points à modifier/améliorer : il pourrait être intéressant de sonder les étudiants sur leurs « croyances » : qui se soigne par « médecines douces » ? La relativité est-elle une élucubration théorique ? Cela afin que les étudiants se rendent compte qu’ils entrent eux-mêmes dans les statistiques citées en cours. Toutefois, il existe un biais important : connaissant le thème de l’enseignement, ils risquent de fournir des réponses plus « raisonnables ».

Séance 2 : pour bien identifier ce que l’on peut appeler science, nous revenons sur la démarche scientifique. Cette qualification de « scientifique » est néanmoins problématique. En effet, pour un public scientifique, elle est acceptée mais pour d’autres publics elle peut-être rejetée car elle semble exclusive (confusion entre « démarche scientifique » et « démarche des scientifiques »). Le terme de « démarche d’investigation » est alors privilégié. Ensuite, nous insistons sur la notion de « affirmation testable » qui définit la barrière entre science et pseudo-sciences. Dès lors que l’on peu tester une affirmation (c’est-à-dire mettre en place une démarche d’investigation expérimentale), il faut surtout ne pas se gêner puisque cela permet de sortir de la discussion de comptoir et juger sur du factuel. Néanmoins, une expérience discriminante (entre deux hypothèses) reste délicate à établir à cause de possibles écueils. Avec la participation des étudiants, on construit alors une « bonne » expérience à partir de l’affirmation « je sais détecter la présence d’une balle sous un gobelet à l’aide de mon pendule ». On définit alors les points essentiels d’un protocole expérimental le plus complet possible.

Points forts : participation des étudiants ; présentation de la démarche scientifique (démarche d’investigation) que certains découvrent malgré leur cursus scientifique.

Points faibles : il y en a sûrement …

Points à modifier/améliorer : il serait formateur de faire la « démonstration » d’un pouvoir qui les surprenne vraiment par un bon tour de prestidigitation afin qu’ils mettent en place une expérimentation rigoureuse.

Séance 3 : en utilisant les notions vues en séance 2, on montre les pièges à éviter lors de l’étude d’un phénomène et également on donne des outils pour conduire son esprit critique. Il s’agit principalement de présenter et d’illustrer, par divers exemples classiques (sang de Saint Janvier, Cosmonaute Maya, etc.), les facettes et effets de la zététique illustrés, entre autres, par Henri Broch, et le CorteX.

Points forts : on donne une boîte à outils critiques à l’usage des citoyens.

Points faibles : le caractère « catalogue » de cette partie du cours tend à endormir les étudiants (et les enseignants également).

Points à modifier/améliorer : une des pistes d’amélioration est de passer de notre approche d’apprentissage par explication (de la théorie vers l’expérience où l’on propose d’abord des outils que l’on utilisera ensuite aux séances 4 et 5) à l’approche d’apprentissage par induction privilégiant la séquence expérience puis théorie.

Séance 4 : il s’agit ici de mettre en œuvre les pièges et outils vus à la séance précédente à l’aide d’études de cas. Sont abordés : les médias, l’astrologie, le sarcophage d’Arles-sur-Tech, la manipulation et l’homéopathie. Nous présentons ainsi la démarche d’investigation face à ces phénomènes étonnants : d’abord, de quoi parle-t-on ? La première étape est donc une étape de documentation la plus étayée, indépendante et recoupée possible. Ensuite, quels sont les pièges identifiés qui peuvent nous induire en erreur. Quels outils permettent de disséquer le phénomène et son contexte ? Eventuellement, est-il possible de tester soit même, par des expériences, certaines assertions ?

Points forts : beaucoup plus parlant que la séance précédente. Beaucoup d’étonnement de la part des étudiants en face d’informations qu’ils n’ont jamais eues (mais qu’ils n’ont jamais pensées aller chercher).

Points faibles : parfois, des considérations un peu techniques font perdre le fil.

Séance 5 : Bien qu’étonnés des informations obtenues lors de l’étude des cas, beaucoup d’étudiants se pensent à l’abri de dérapage « d’esprit critique », protégés par leur carapace « scientifique ». Dans cette dernière séance, il convient donc de montrer que cela n’est pas le cas. L’esprit critique est un travail de tous les jours et les scientifiques sont avant tout des hommes et des femmes avec leurs convictions, leurs croyances et leurs failles. Après avoir insistés sur le bienfait de l’erreur en science, son côté indispensable et sain, nous présentons les bavures scientifiques, c’est-à-dire non les erreurs scientifiques mais les erreurs de scientifiques : les expériences d’Yves Rocard sur le biomagnétisme, celles d’Eddington pour prouver la relativité, les rayons N et la mémoire de l’eau pour clore l’ensemble.

Points forts : cette partie originale touche les étudiants scientifiques en leur montrant qu’une bavure est vite arrivée.

Points faibles : tout comme la partie précédente, des aspects un peu techniques coupent parfois l’attention.

Denis Machon

Analyse de Maïlys

Dans le cadre du stage de zététique donné à Lyon 1 par Denis Machon, je suis intervenue avec deux cours d’environ une heure chacun. J’ai également présenté ces deux cours lors de « Student club » dans mon laboratoire (Institut Cellule Souche et Cerveau à Bron), qui sont des réunions où les étudiants présentent leur travail aux autres et parlent de sujets scientifiques qui les intéressent.

Le premier cours concernait le traitement de l’information (scientifique mais aussi non scientifique) par les médias (médias de vulgarisation scientifique ou généralistes).

Pour construire ce cours, je me suis appuyée sur la thèse de Richard Monvoisin ainsi que sur les exercices pédagogiques et exemples proposés sur cortecs.org. Ce cours avait pour but d’illustrer de façon concrète les effets zététiques présentés par Denis Machon lors des enseignements précédents.

Le cours était divisé en 4 points :

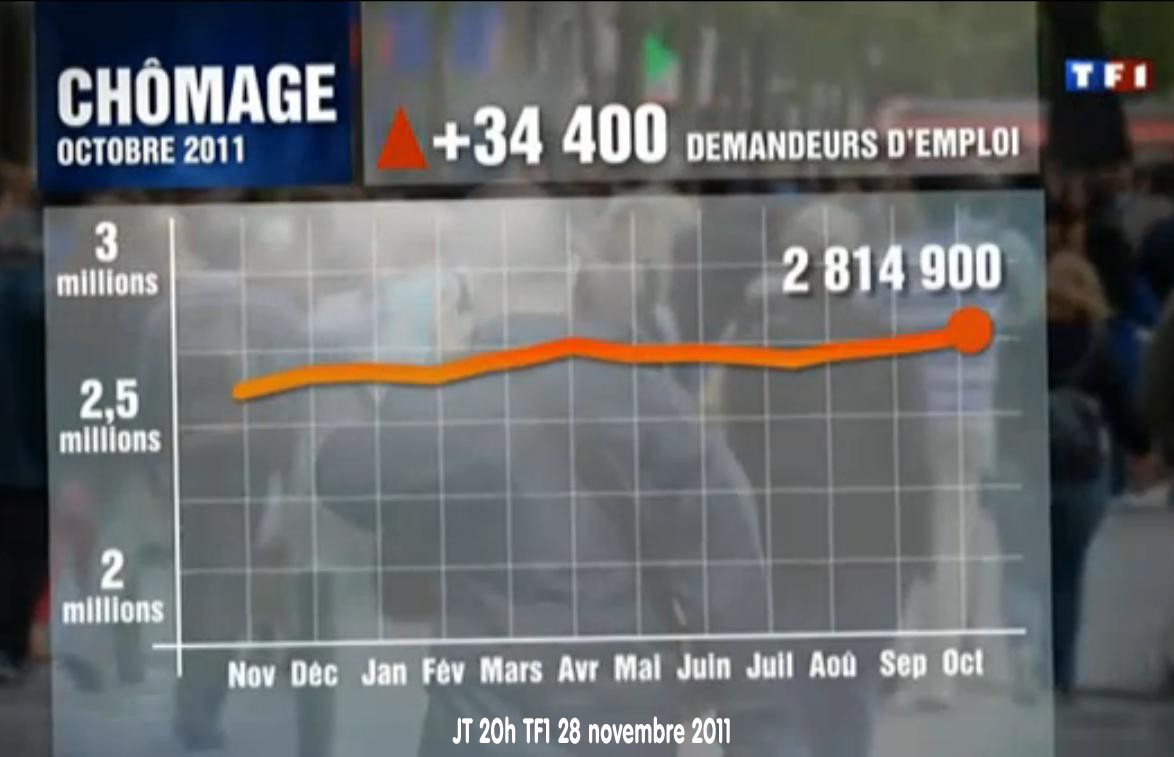

1 ) « Les mots » : où j’ai insisté sur l’importance du choix des mots et des images par les médias (effet Paillasson, effet Impact, effet Puits)

2) « Les arguments » : où j’ai présenté comment on pouvait donner plus de valeur à une information qu’elle ne le mérite réellement selon la façon dont elle était défendue (arguments d’autorité, effet Cigogne, effet Bipède)

3) « Les registres » : où j’ai montré des exemples de scénarisation de l’information (tous les carpaccios)

4) « Autres effets » pour rester vigilant : la technique de la « peau de chagrin » (rebaptisée « ballon de baudruche » pour ce cours pour l’image du scoop qui se dégonfle au fur et à mesure de la lecture de l’article. Je l’ai rebaptisée car je ne trouve pas le concept de « peau de chagrin » très parlant) ; la « vente de la peau de l’ours » pour l’importance de la vérification des sources de l’information et enfin, un dernier point sur les chiffres.

Les personnes qui sont venues me parler du cours l’ont trouvé intéressant notamment parce que je montre que les médias de vulgarisation scientifique les plus connus utilisent souvent les mêmes procédés que les autres médias pour vendre leur information alors qu’ils bénéficient en général d’une « aura de rigueur » de par leur lien avec la science.

Par contre, ce cours dresse un tableau assez pessimiste sur les médias, ce qui a un peu déprimé les étudiants. Un étudiant a par exemple demandé : « Mais alors, si on ne peut rien croire, comment peut-on faire pour avoir de l’information valable ? » ; peut-être parce que je n’ai pas assez proposé de solutions (comme la multiplication des sources d’information par exemple) ?

Lorsque j’ai présenté ce cours en Student club (avant de donner le cours aux étudiants), on m’a reproché d’avoir trop d’exemples tirés de Science & Vie, ce qui faisait un peu comme si j’avais une dent particulièrement contre ce magazine. Au début, j’avais aussi beaucoup d’exemples de médias de vulgarisation scientifique, et peu de médias généralistes ce qui empêchait un peu de réaliser que les deux types de médias fonctionnent de la même façon. Du coup, j’ai essayé de mettre des exemples d’autres magazines que Science & Vie ainsi que de magazines plus généralistes pour permettre de faire le lien.

On m’a également fait remarquer que je parlais des « médias » en général mais que concrètement, je tirais essentiellement mes exemples des médias écrits, et pas tellement de la télévision, ou de la radio ou d’Internet. Il faudra que j’essaie d’élargir mes exemples pour le prochain cours ou que je cantonne mes conclusions aux médias écrits.

Pour ce cours, je n’ai pas du tout traité du monde du journalisme et de son fonctionnement, ce qui pourrait être très intéressant. Je pense notamment aux réflexions de P. Bourdieu (en particulier celles résumées dans son livre « Sur la télévision »). Il faudra que j’essaie d’introduire un peu ces idées pour l’an prochain.

A la fin du cours, j’ai mentionné le film « Les nouveaux chiens de garde » qui venait de sortir en salle. Des extraits de ce film pourraient être montrés pour illustrer les liens douteux entre politiques et médias (à disctuer).

Mon deuxième cours était une petite présentation d’expériences de psychologie sociale sur la manipulation. Pour réaliser ce cours, je me suis appuyée sur le livre « Petit traité de manipulation à l’usage des honnêtes gens » de Joule et Beauvois. Le but de ce cours était de montrer comment la façon dont on prend les décisions, qui est plutôt bien adaptée à la vie de tous les jours, peut, dans certaines situations, nous être défavorable. Les expériences de psychologie sociale que j’ai présentées montrent comment on peut changer de manière significative le comportement ou les opinions des gens en jouant sur les concepts d’engagement et d’effet de gel.

Ce cours est bien passé dans le sens où les expériences présentées sont assez amusantes. Cependant, je ne suis pas sûre d’être arrivée à faire passer clairement ce qu’elles montraient réellement, la théorie derrière étant finalement assez complexe.

Je n’ai pas eu trop d’interventions de la part des étudiants lors du cours mais j’en ai eu beaucoup lors du Student club. De manière assez récurrente, les personnes à qui je présente ces expériences se bloquent sur les diverses interprétations possibles de l’expérience, ce qui est intéressant en soi mais qui nuit un peu à la compréhension du fond. Pour chaque expérience présentée, il existe plusieurs interprétations possibles et une expérience, seule, ne permet pas de trancher (ce qui est le principe de construction de la science). Sauf que j’ai eu du mal à faire passer l’idée que l’interprétation proposée n’était pas le résultat de ces expériences seules mais de tout un tas d’expériences, qui, en faisant varier les conditions, sont parvenues à ces conclusions, les meilleures du moment. C’est un point sur lequel il est peut-être nécessaire de bien insister au début du cours, lors de l’introduction par exemple.

Maïlys Faraut, Université Lyon 1

Télécharger les cours de Maïlys Faraut :

– Cours sur la manipulation

– Cours sur le traitement de l’information par les médias

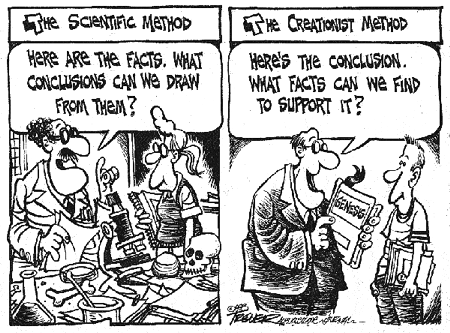

On ne s’attardera pas sur les créationnismes « négationniste » et « mimétique ». Ils se fondent sur le récit de la création de l’univers dans les grands textes monothéistes, pris de façon littérale. Les contradictions qui en résultent provoquent une négation des résultats des sciences dans le premier cas, ou bien une « science créationniste » qui établit les prétendues preuves de la vérité littérale du texte dans le second cas. Le premier est notamment représenté par Harun Yahya, pseudonyme de M. Adnan Oktar, homme d’affaires et d’influence turc, qui distribua en janvier 2007 dans toute l’Europe son Atlas de la Création, (auto-édité, Global Publishing) y compris dans les établissements scolaires et laboratoires français. En janvier 2012, via Harun Yahya France, il organisait à Paris, à Rouen et à Évry, une série de conférences : « L’impasse moléculaire de la théorie de l’évolution » « l’effondrement de la théorie de l’évolution »…

On ne s’attardera pas sur les créationnismes « négationniste » et « mimétique ». Ils se fondent sur le récit de la création de l’univers dans les grands textes monothéistes, pris de façon littérale. Les contradictions qui en résultent provoquent une négation des résultats des sciences dans le premier cas, ou bien une « science créationniste » qui établit les prétendues preuves de la vérité littérale du texte dans le second cas. Le premier est notamment représenté par Harun Yahya, pseudonyme de M. Adnan Oktar, homme d’affaires et d’influence turc, qui distribua en janvier 2007 dans toute l’Europe son Atlas de la Création, (auto-édité, Global Publishing) y compris dans les établissements scolaires et laboratoires français. En janvier 2012, via Harun Yahya France, il organisait à Paris, à Rouen et à Évry, une série de conférences : « L’impasse moléculaire de la théorie de l’évolution » « l’effondrement de la théorie de l’évolution »… Or, les créationnismes et spiritualismes cités ont tous un point commun, leur ignorance, réelle ou feinte, de la nature et du périmètre de légitimité de la démarche et du discours scientifiques : ce que les sciences disent, comment elles le disent, ce qu’elles ne disent pas. Quand l’UIP somme les chercheurs de réfléchir aux « conséquences métaphysiques » de leurs découvertes (Le Monde, 23 février 2006) et affirme qu’« un créateur ne peut être exclu du champ de la science », (Le Monde, 2 septembre 2006), elle « oublie » que le propre des sciences n’est jamais de dire ce qu’il faut « croire », mais de démontrer ce qu’il n’est logiquement plus possible de croire. Mais surtout, elle omet de dire si les scientifiques sont appelés à se prononcer sur ces questions à titre individuel, ou à titre collectif. La confusion entraîne le métier de scientifique d’aujourd’hui au delà de sa légitimité. Il s’agit bien là d’une forme de scientisme déguisé. En organisant la confusion entre la quête spirituelle individuelle et le contrat collectif d’une profession, ces offensives peuvent avoir pour effet, à terme, de faire perdre l’autonomie des scientifiques dans la validation des savoirs. En effet, si la profession se voyait collectivement animée d’un agenda métaphysique, il lui faudrait s’attendre à se voir imposé ce qu’il serait conforme de trouver. L’universalisme des connaissances raisonnées, qui tient aujourd’hui précisément à une abstention métaphysique, ne serait plus possible et l’on assisterait à une communautarisation des savoirs.

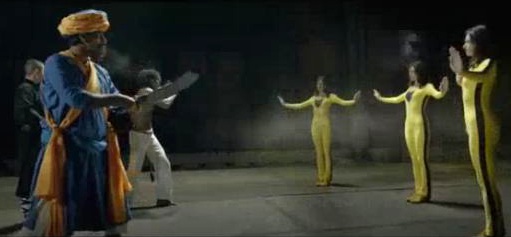

Or, les créationnismes et spiritualismes cités ont tous un point commun, leur ignorance, réelle ou feinte, de la nature et du périmètre de légitimité de la démarche et du discours scientifiques : ce que les sciences disent, comment elles le disent, ce qu’elles ne disent pas. Quand l’UIP somme les chercheurs de réfléchir aux « conséquences métaphysiques » de leurs découvertes (Le Monde, 23 février 2006) et affirme qu’« un créateur ne peut être exclu du champ de la science », (Le Monde, 2 septembre 2006), elle « oublie » que le propre des sciences n’est jamais de dire ce qu’il faut « croire », mais de démontrer ce qu’il n’est logiquement plus possible de croire. Mais surtout, elle omet de dire si les scientifiques sont appelés à se prononcer sur ces questions à titre individuel, ou à titre collectif. La confusion entraîne le métier de scientifique d’aujourd’hui au delà de sa légitimité. Il s’agit bien là d’une forme de scientisme déguisé. En organisant la confusion entre la quête spirituelle individuelle et le contrat collectif d’une profession, ces offensives peuvent avoir pour effet, à terme, de faire perdre l’autonomie des scientifiques dans la validation des savoirs. En effet, si la profession se voyait collectivement animée d’un agenda métaphysique, il lui faudrait s’attendre à se voir imposé ce qu’il serait conforme de trouver. L’universalisme des connaissances raisonnées, qui tient aujourd’hui précisément à une abstention métaphysique, ne serait plus possible et l’on assisterait à une communautarisation des savoirs. Dans un premier temps, j’ai introduit un support, une vidéo d’un clip de la Commission Européenne de mars 2012 visant à promouvoir l’élargissement auprès des jeunes. La vidéo est restée quelques heures en lignes et a fait scandale car on y voit une jeune femme blanche (habillée comme Uma Thurman dans le film Kill Bill, de Q. Tarantino) se faisant agresser par des guerriers chinois, brésiliens et indiens maniant chacun un art martial national. Pour se défendre la jeune femme se dédouble jusqu’à former un cercle autour des guerriers les invitant à la négociation. Le slogan est : « the more we are, the stronger we are » : plus nous sommes nombreux, plus nous sommes forts.

Dans un premier temps, j’ai introduit un support, une vidéo d’un clip de la Commission Européenne de mars 2012 visant à promouvoir l’élargissement auprès des jeunes. La vidéo est restée quelques heures en lignes et a fait scandale car on y voit une jeune femme blanche (habillée comme Uma Thurman dans le film Kill Bill, de Q. Tarantino) se faisant agresser par des guerriers chinois, brésiliens et indiens maniant chacun un art martial national. Pour se défendre la jeune femme se dédouble jusqu’à former un cercle autour des guerriers les invitant à la négociation. Le slogan est : « the more we are, the stronger we are » : plus nous sommes nombreux, plus nous sommes forts.

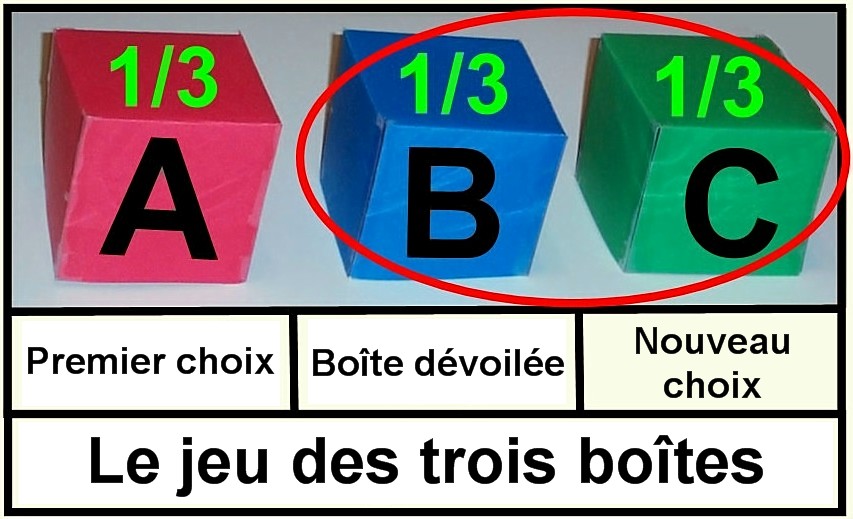

ne changez pas de probabilité de succès, qui demeure un tiers. En changeant toujours de choix, vos chances de succès sont deux fois plus grandes. Car, en dévoilant l’une des boîtes qui n’a pas d’argent sous elle, le maître de cérémonie vous offre effectivement l’ensemble des deux choix qui restent, dont la probabilité égale deux tiers. La figure ci-contre illustre ce concept.

ne changez pas de probabilité de succès, qui demeure un tiers. En changeant toujours de choix, vos chances de succès sont deux fois plus grandes. Car, en dévoilant l’une des boîtes qui n’a pas d’argent sous elle, le maître de cérémonie vous offre effectivement l’ensemble des deux choix qui restent, dont la probabilité égale deux tiers. La figure ci-contre illustre ce concept.

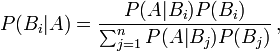

, on a :

, on a :

Puis c’est le regretté Martin Gardner, incontournable pionnier de la pensée critique décédé en 2010, qui l’exhuma en 1959 dans sa rubrique Mathematical Games du Scientific American sous le nom de « problème des trois prisonniers » (« Mathematical Games » column, Scientific American, October 1959, pp. 180–182). Enfin, c’est Steve Selvin qui rouvrit la question dans «

Puis c’est le regretté Martin Gardner, incontournable pionnier de la pensée critique décédé en 2010, qui l’exhuma en 1959 dans sa rubrique Mathematical Games du Scientific American sous le nom de « problème des trois prisonniers » (« Mathematical Games » column, Scientific American, October 1959, pp. 180–182). Enfin, c’est Steve Selvin qui rouvrit la question dans «  Louis Dubé nous offre en prime un court programme commenté en langage Basic qui simule ce problème avec « N » boîtes (donc aussi avec 3 boîtes).

Louis Dubé nous offre en prime un court programme commenté en langage Basic qui simule ce problème avec « N » boîtes (donc aussi avec 3 boîtes).